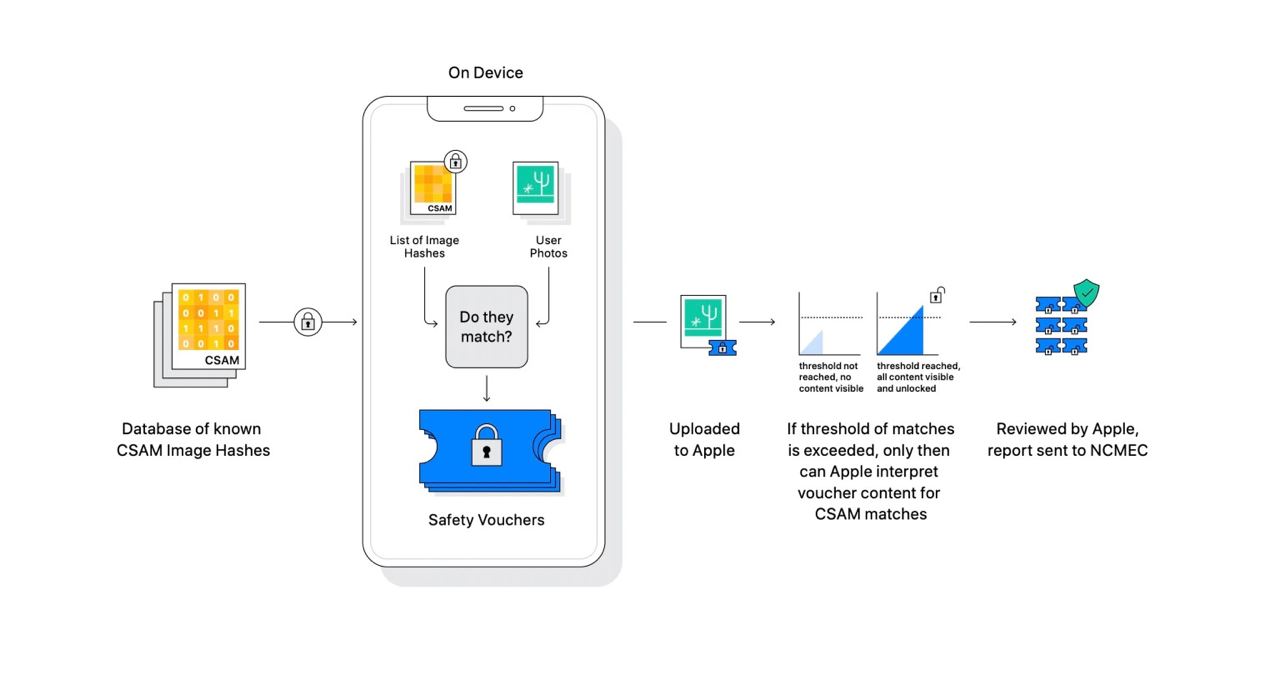

Apple baru-baru ini telah memperkenalkan sebuah fungsi baharu yang akan tersedia di iOS 15, iPadOS 15 serta macOS dimana ia membenarkan Apple untuk mengimbas gambar pada peranti bagi mengetahui sekiranya terdapat bahan pornografi melibatkan kanak-kanak atau CSAM.

Oleh yang demikian, Ketua WhatsApp Will Cathcart mempersoalkan fungsi tersebut. Ini kerana Apple secara tidak langsung telah membina sebuah sistem pengawasan untuk mengimbas kandungan peribadi pengguna.

Selain itu, beliau turut mendakwa yang mana sistem sebegitu boleh dieksploitasi oleh kerajaan seperti China atau mana-mana pihak.

Bagi membalas kenyataan itu, jurucakap Apple mengatakan pengguna boleh mematikan fungsi memuat naik gambar di iCloud Photos. Tambahan lagi, Apple juga menyatakan sistem tersebut dilatih untuk mengesan foto berdasarkan pangkalan data National Center for Missing and Exploited Children (NCMEC).

Jadi, organisasi selain Apple tidak dapat mengeksploitnya kerana fungsi ini sudah terbina dalam iOS itu sendiri.

Sebenarnya tidak pelik isu ini terjadi memandangkan Facebook dengan Apple sudah banyak kali ‘bergaduh’ terutama berkaitan privasi. Di samping itu, Google dan Microsoft diikutkan turut mempunyai fungsi sedemikian.

Baca juga: