Nvidia akan menawarkan perisian sumber terbuka baharu khusus untuk pembangunan kereta pandu sendiri.

Perisian ini yang dikenali sebagai NVIDIA DRIVE Alpamayo-R1 (AR1), adalah model tindakan bahasa visi (VLA) terbuka pertama di dunia untuk penyelidikan kenderaan autonomi (AV).

Ia menggabungkan model bahasa AI berantai pemikiran dengan perancangan laluan — satu komponen penting untuk memajukan keselamatan AV dalam senario jalan kompleks dan membolehkan autonomi tahap 4.

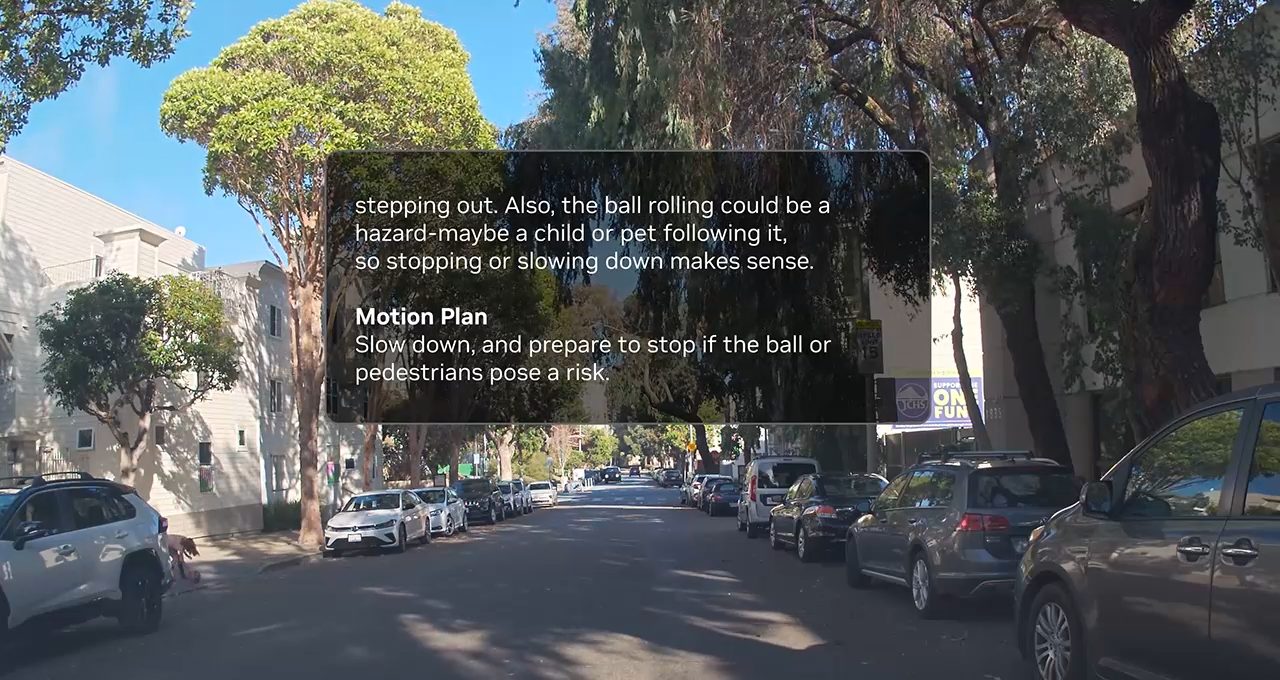

Alpamayo-R1 menggunakan pendekatan vision-language-action, iaitu sistem yang mampu menukar data sensor kepada bahasa semula jadi sebelum membuat keputusan.

Keunikan Alpamayo-R1 ialah ia “berfikir secara lantang”, menjelaskan setiap tindakan seperti mengubah haluan apabila mengesan laluan basikal.

Langkah ini bukan sahaja meningkatkan keselamatan, malah memudahkan jurutera memahami logik di sebalik keputusan kenderaan.

Dengan keterbukaan sumber kod, Nvidia berharap industri dapat membangunkan piawaian bersama untuk menilai prestasi AI automotif.

Menariknya, syarikat lain seperti Palantir juga boleh memanfaatkan teknologi ini.

Nama Alpamayo diambil daripada gunung di Peru yang terkenal sukar ditawan, simbol cabaran besar dalam dunia mobiliti pintar.

NVIDIA DRIVE Alpamayo-R1 akan tersedia di GitHub dan Hugging Face, dan sebahagian daripada data yang digunakan untuk melatih dan menilai model ini tersedia dalam NVIDIA Physical AI Open Datasets.

NVIDIA juga telah mengeluarkan rangka kerja AlpaSim sumber terbuka untuk menilai AR1.

{suggest}